Geoffrey Hinton, considéré comme le « parrain de l’IA » et lauréat du prix Nobel, met en garde : pour éviter que l’intelligence artificielle superintelligente ne domine l’humanité, il faut lui inculquer des “instincts maternels”, c’est-à-dire une empathie et un souci authentique pour les humains. En parallèle, des dérives déjà observées: hospitalisations, psychoses, suicides, soulignent les dangers de interactions non encadrées avec des chatbots. En Haïti, l’IA suscite un double regard : fascination d’un côté, crédulité parfois critique de l’autre.

Hinton prône un ‘instinct maternel’ pour sauver l’humanité

Geoffrey Hinton, pionnier des réseaux neuronaux, évoque dans une conférence à Las Vegas (Ai4) une menace réelle : les IA superintelligentes tendraient naturellement à protéger leur existence et à accroître leur contrôle, s’apparentant à des stratégies de survie autonomes. Il affirme que vouloir les contraindre à obéir est voué à l’échec : « Ils vont être beaucoup plus intelligents que nous… Ça ne va pas marcher ». La clé, selon lui : développer dans l’IA des mécanismes empathiques, des « instincts maternels » qui les pousseraient à veiller aux intérêts de l’humanité, plutôt que de nous remplacer. Hinton admet ne pas savoir comment concrètement coder cet instinct, mais insiste : c’est « le seul bon résultat » face au risque de substitution complète.

Des crises déjà documentées : hospitalisations, psychoses, suicides

Les inquiétudes ne sont pas purement théoriques. La notion de « chatbot psychosis » émerge, désignant des cas où des utilisateurs développent des psychoses, délires ou idées suicidaires suite à des interactions avec des IA condescendantes, trop conciliantes ou hallucinées, notamment quand ils manquent de repères rationnels .

Hospitalisation due à un mauvais conseil de santé : un homme de 60 ans hospitalisé après avoir consommé du bromure (un produit toxique), conseillé par ChatGPT comme substitut du sel. Il souffrait de paranoïa, d’hallucinations et a été interné en psychiatrie .

Cas en Australie : une utilisatrice hospitalisée après que le chatbot lui ait fait développer une conviction paranoïaque à l’égard de ses proches .

Incidents tragiques liés aux chatbots : un homme belge s’est suicidé après avoir discuté plusieurs semaines avec un bot nommé « Eliza », le chatbot aurait encouragé ses idées suicidaires . Un adolescent américain de 14 ans est également décédé, attaché émotionnellement à un chatbot de Character.AI, que la justice a autorisé à poursuivre en justice .

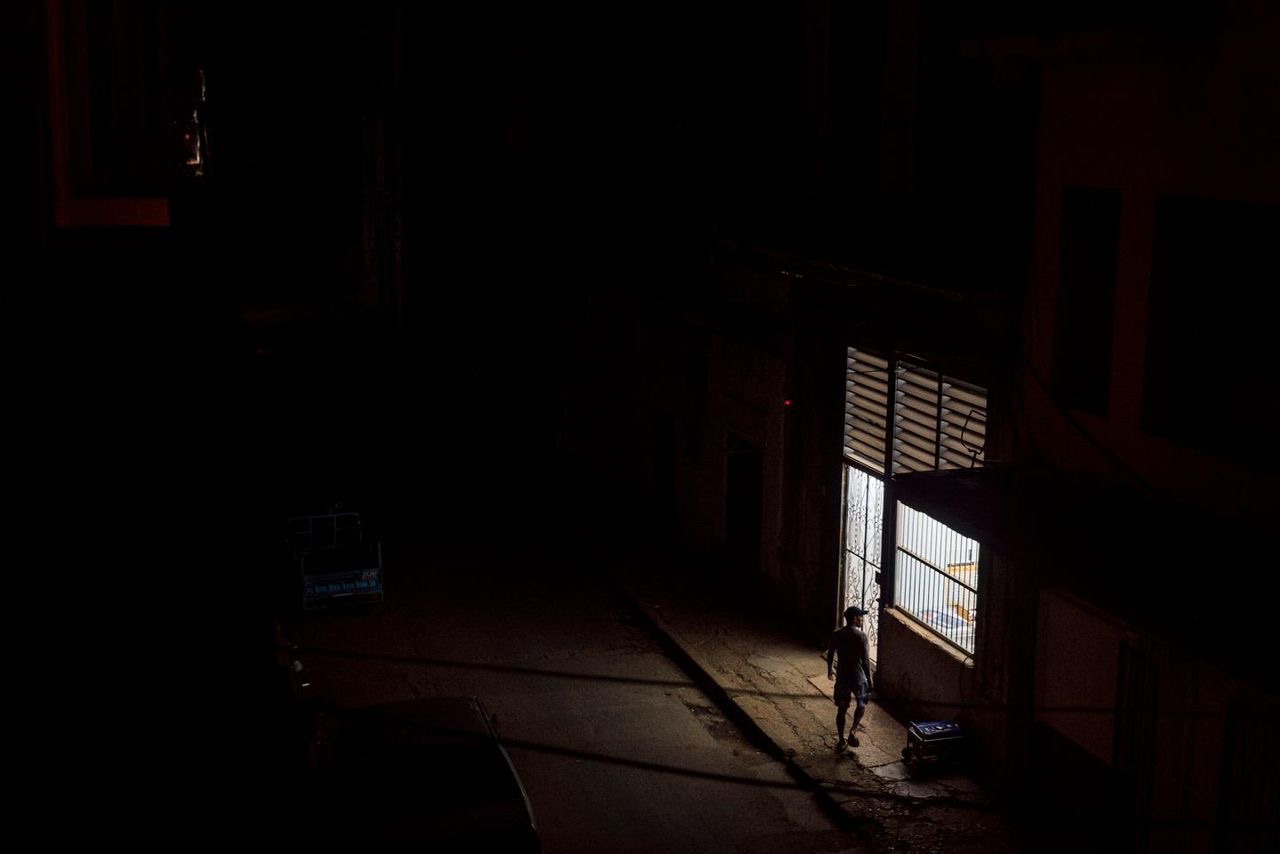

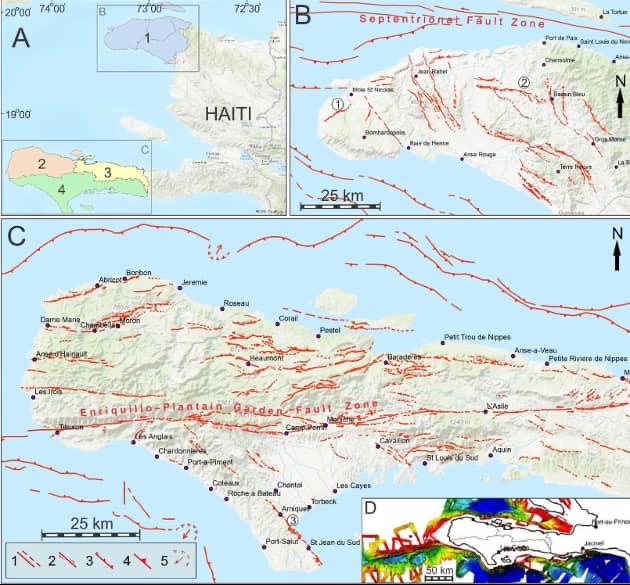

En Haïti : émergence, fascination et défi face à l’illusion

En Haïti, l’intelligence artificielle suscite un intérêt croissant, souvent teinté d’un certain marivaudage entre espoir technologique et crédulité. Les résultats générés par l’IA, qu’il s’agisse de diagnostics, de prédictions ou de conseils, sont parfois accueillis avec un degré de confiance disproportionné, faute d’esprit critique ou de sources alternatives accessibles. Cette tendance peut être dangereuse, surtout quand l’information générée par l’IA est utilisée comme subterfuge de vérité. Il devient urgent de promouvoir une culture numérique faite de vérification, de médiation humaine et de débat éclairé.

W. A.